长期以来,人工智能 (AI) 一直让一些人着迷,但也遭到了其他人的批评。很难预测人工智能可以做什么,什么做不了。温哥华不列颠哥伦比亚大学 (UBC) 的一组学者想出了一个看似科幻的东西:一个完全自主的人工智能科学家。这个人工智能可以分析数据,还可以创建和运行实验。这一发现既令人着迷,也对某些人来说令人不安。

虽然 AI 科学家的想法似乎是一个遥不可及的梦想,但 UBC 团队通过与牛津大学和 Sakana AI 的合作将其变成了现实。虽然这些由 AI 生成的工作论文最初可能对科学贡献不大,但它们是从实验中机器学习的结果,而且它们有效,这一事实代表了 AI 研究的进步。

永不停止学习的人工智能科学家

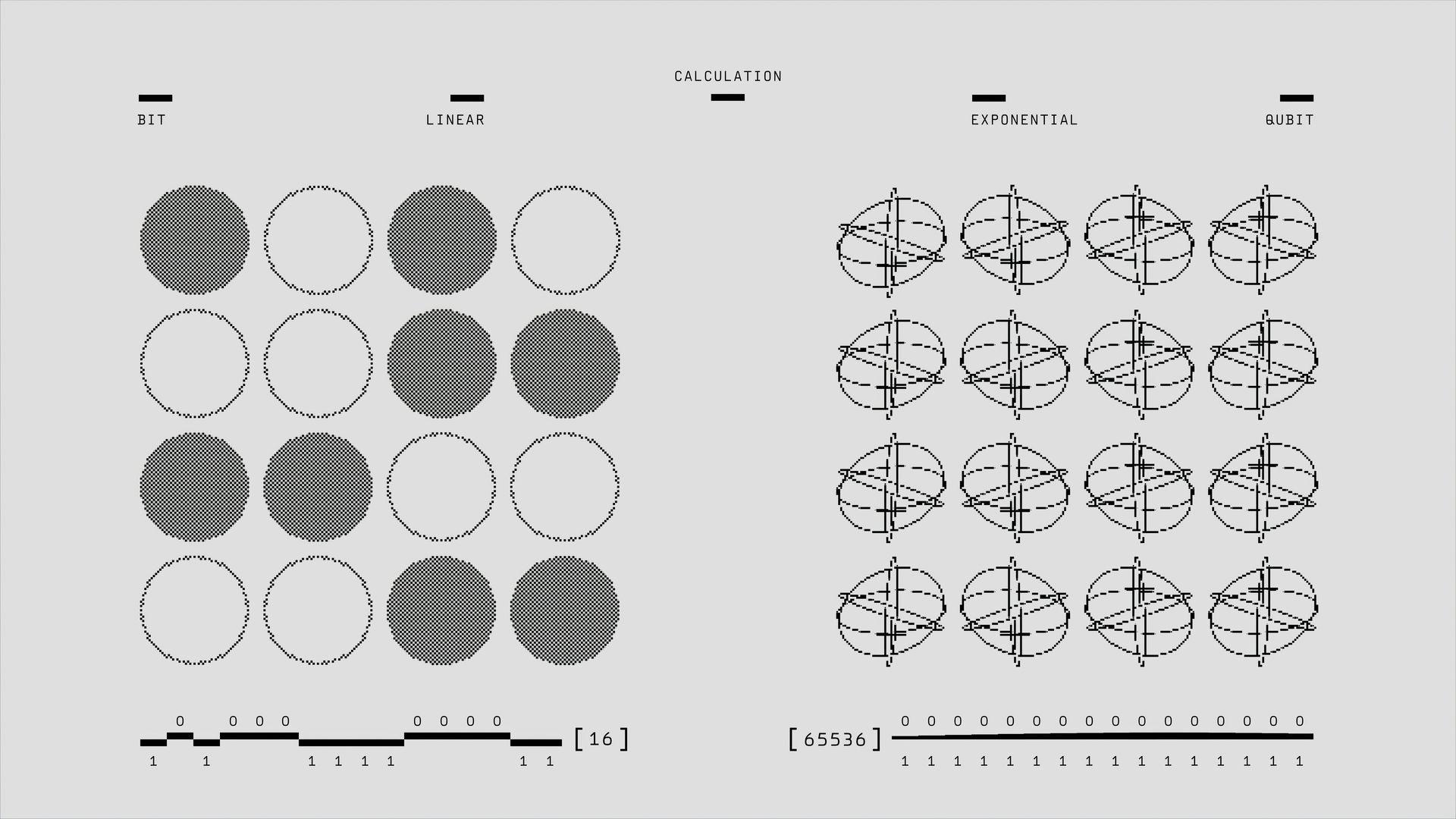

这项研究以开放式学习方法为中心。这种新型人工智能科学家的工作方式与传统人工智能不同,传统人工智能依赖于人类创造的大量数据。它通过尝试新事物、研究新事物并加以改进来学习。利用这种技术,人工智能可以拓展现有知识的边界,或许还能发现人类研究人员可能错过的新见解。

这位人工智能科学家着手解决的首要任务之一是改进现有的机器学习技术,例如扩散建模和加速深度神经网络。虽然这些似乎不是惊天动地的进步,但它们代表了人工智能自主开发和测试想法的能力。人工智能本身在刚出现时无法做很多事情,但现在它已经开始进入我们生活的方方面面。

不列颠哥伦比亚大学实验室主任杰夫·克鲁恩教授承认,这些结果不一定是成功的,但很有希望。这位人工智能科学家的学习方法——不断改进他的实验,寻找他认为“有趣”的东西——与人工智能研究中传统使用的较为僵化的方法截然不同。

人工智能科学家独立地测试和完善他们的理论

Clune 的实验室一直在尝试开放式学习。在之前的项目中,他们开发了旨在探索虚拟环境并根据他们感兴趣的内容产生行为的人工智能程序。这些程序必须通过手工编码的指令进行精心引导,但大型语言模型 (LLM) 的引入改变了游戏规则。现在,这些人工智能程序可以独立确定哪些内容值得研究,从而使它们更加自主,并且可能更具创造力。

人工智能科学家能够编写验证其理论所需的代码,以及运行测试,这是他们最迷人的特质之一。这使人工智能能够不断完善其策略,变得越来越有效,甚至可能更加敏锐。克鲁恩将这一过程比作发现新大陆,因为两者都涉及探索精神和未知,以及沿途可能出现的巨大惊喜。

尽管这类系统前景光明,但其可靠性却很差。尽管人工智能科学家似乎很了不起,但艾伦人工智能研究所的研究员汤姆·霍普 (Tom Hope) 表示,人工智能仍然具有高度衍生性和不可靠性。这种不信任源于人工智能承诺过多但表现不佳的事实,尤其是在创造力和真正创新方面。

管理潜力和风险

随着人工智能科学家的诞生,人们对科研方向的担忧也随之而来。当人工智能能够自己创造和评估理论时,人类研究人员又将何去何从?此外,我们如何确保这些人工智能技术得到恰当的使用?一个心怀恶意的人是否会在家里训练出一名人工智能科学家,并在未来将其用于邪恶目的?

这位人工智能科学家已经在创建人工智能代理方面取得了进展,人工智能代理是具有预定功能的自主程序。Clune 的团队已经创建了人工智能设计的代理,这些代理在数学和阅读理解等技能方面的表现优于人类设计的代理。这一成功表明,未来人工智能可以以尚不清楚的方式促进创新,而不仅仅是协助日常活动。

但这种进步也存在危险。令人担忧的是,这些人工智能系统可能会产生行为不当的代理,无论是有意还是无意。Clune 和他的团队意识到了这些风险,并试图找到解决方案来阻止此类情况的发生。他们认为,关键在于妥善监督这些系统的开发,以确保其强度和安全性。

虽然尚不清楚这将导致什么结果,但有一件事是肯定的:人工智能科学家已经存在,而且他们不会停止变得更聪明。人工智能即将进入一个新阶段,每个人都将密切关注它是否会带来突破性的发现或新的问题。随着人工智能的发展,学术界必须强调道德问题,并确保这些系统的构建符合道德规范。最终,我们如何处理技术与人类之间的复杂关系将决定人工智能如何影响社会。

特色图片来源:国家癌症研究所/Unsplash

Source: 人工智能科学家研究学习和发现