Nvidia Grace CPU 和 Nvidia H100 在 Nvidia GTC 2022 上亮相。Nvidia 今天宣布了其下一代 Hopper GPU 架构和 Hopper H100 GPU,以及将 GPU 与高性能 CPU 相结合的新数据中心芯片,被称为“ Grace CPU Superchip”(不要与 Nvidia 的其他 Grace 超级芯片混淆)。

Nvidia Grace CPU:规格、价格和发布日期

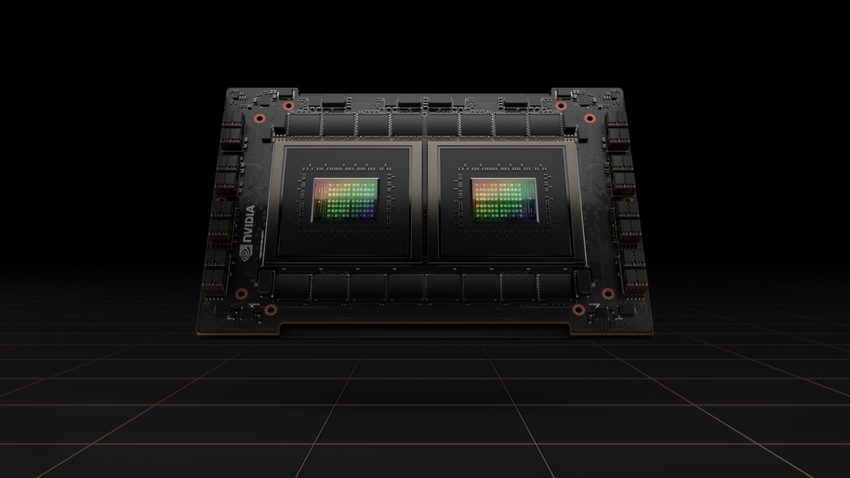

Nvidia GPU Superchip 是该公司对专用数据中心 CPU 的首次尝试。 根据英特尔泄露的信息,基于 Arm 的芯片将具有惊人的 144 个内核和每秒 1 TB 的内存带宽。 它实际上结合了两个通过 Nvidia 的 NVLink 互连连接的 Grace CPU——这可与 Apple 的 M1 Ultra 架构相媲美。

新 CPU 将搭载快速 LPDDR5X 内存,预计将于 2023 年上半年交付,其性能将是传统服务器的 2 倍。 Nvidia 预测,该芯片将在 SPECrate®2017_int_base 基准测试中获得 740 分,与高端 AMD 和英特尔数据中心处理器正面交锋(尽管其中一些得分更高,但代价是每瓦性能较低)。

“一种新型的数据中心已经出现——处理和提炼大量数据以产生智能的人工智能工厂。 Grace CPU Superchip 在一个芯片中提供最高性能、内存带宽和 NVIDIA 软件平台,并将作为世界人工智能基础设施的 CPU 大放异彩。”

——英伟达创始人兼首席执行官黄仁勋

这种新芯片在很多方面都是去年宣布的 Grace Hopper 超级芯片和 CPU 的自然发展。 Grace Hopper 超级芯片将 CPU 和 GPU 组合成一个单片系统设计。 该系统也将于 2023 年上半年首次亮相,它将包括一个用于大型模型的 600GB 内存 GPU,Nvidia 声称内存带宽将是基本服务器 GPU 的 30 倍。 据英伟达称,这些处理器旨在用于“大规模”人工智能和高性能计算应用。

Grace CPU Superchip 是一款基于 Arm v9 的 SoC,可用于创建具有多达 8 个基于 Hopper 的 GPU 的独立 CPU 或服务器。

该公司表示它正在与“领先的 HPC、超级计算、超大规模和云客户”合作,这意味着这些系统最终将在您附近的云提供商上提供。

尚未共享有关价格的信息。

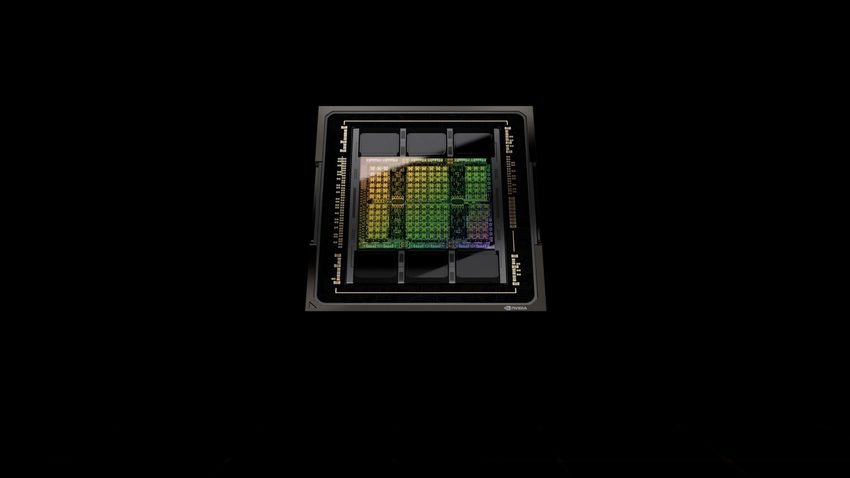

Nvidia H100 GPU:规格、价格和发布日期

Nvidia 正在与 Hopper 一起发布许多新的和改进的技术,但该架构强调变压器模型,这已成为许多应用程序选择的机器学习技术,而 GPT-3 和 asBERT 等功率模型可能是最重要的一种.

H100 芯片的新 Transformer Engine 有望将模型训练速度提高 6 倍,而且由于这种新架构还包括 Nvidia 用于连接众多节点的新 NVLink Switch 系统,由这些芯片驱动的大型服务器集群将能够扩展以支持庞大的网络,开销更少。

“最大的 AI 模型可能需要数月才能在当今的计算平台上进行训练。 这对企业来说太慢了。 人工智能、高性能计算和数据分析变得越来越复杂,一些模型(如大型语言模型)达到数万亿个参数。 NVIDIA Hopper 架构从头开始构建,旨在通过强大的计算能力和快速内存来加速这些下一代 AI 工作负载,以处理不断增长的网络和数据集。”

– 戴夫救世主

客户的 Tensor Cores 可根据需要结合 8 位精度和 16 位半精度,同时保持精度,用于新的 Transformer 引擎。

尚未共享有关价格的信息。