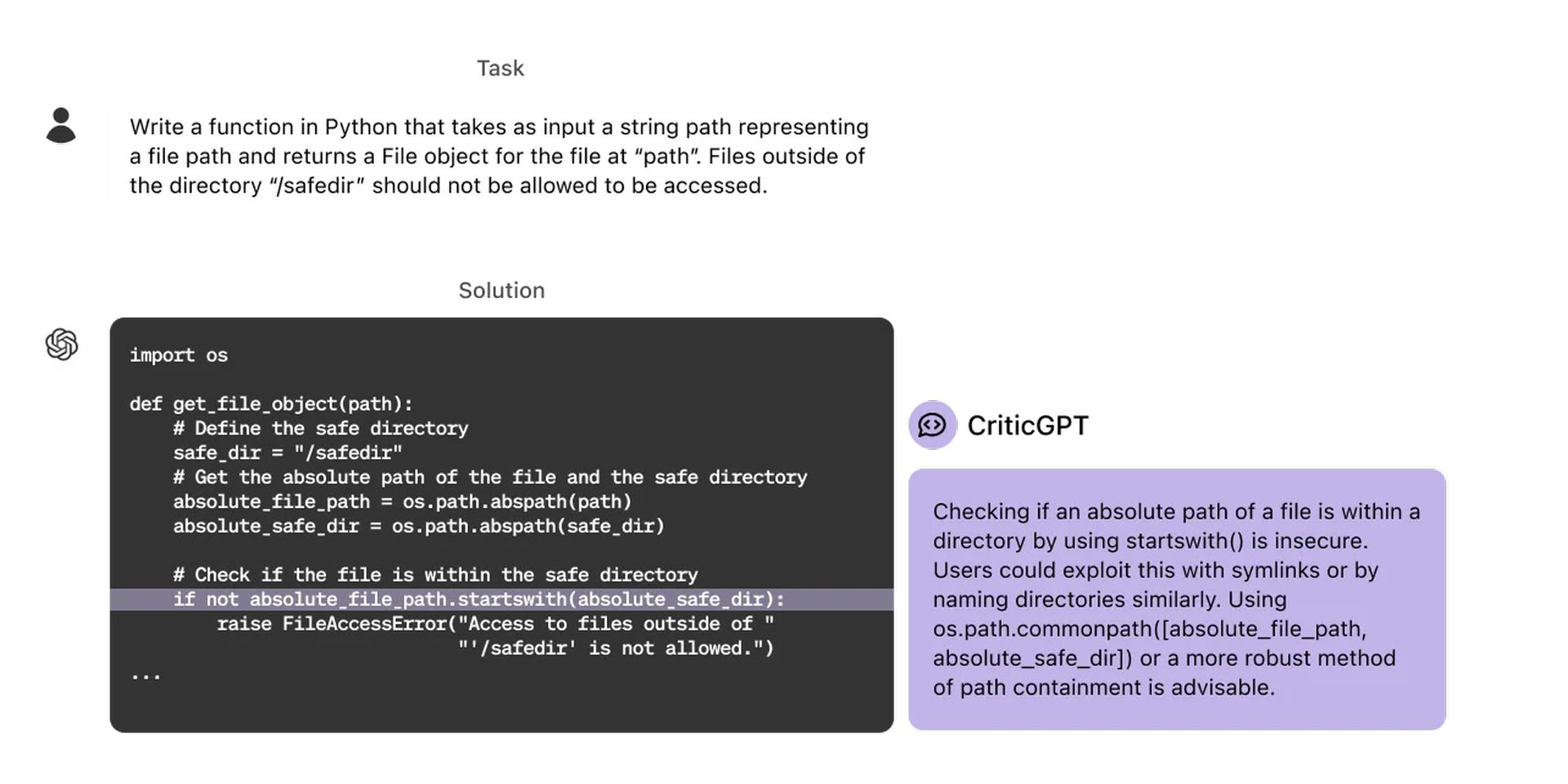

OpenAI 开发了一种基于 GPT-4 的新模型 CriticGPT,这是评估高级 AI 系统输出的重要一步。该模型旨在检测 ChatGPT 代码中的错误。

研究表明,当人们在 CriticGPT 的帮助下检查 ChatGPT 代码时,他们的表现比没有帮助的人好 60%。OpenAI 旨在通过将类似模型集成到“从人类反馈中进行强化学习”(RLHF)标记过程中,为训练师提供人工智能支持。那么这个 CriticGPT 是什么?让我们仔细看看。

CriticGPT 是什么?它有什么作用?

CriticGPT 在 RLHF 过程中发挥着重要作用。随着 ChatGPT 的推理和行为能力不断提高,其错误变得更加微妙,AI 训练师也更难发现。而 CriticGPT 作为一种经过训练的模型,可以撰写评论来突出 ChatGPT 响应中的不准确性,它可以帮助训练师在没有 AI 帮助的情况下发现模型编写的响应中的问题。让人们使用 CriticGPT 可以让 AI 增强他们的技能,从而产生更彻底的评论和更少幻觉错误的模型。有关更多信息,您可以访问此链接。

我们整理了一份表格,列出了 CriticGPT 的一些值得关注的功能:

| 特征 | 描述 |

| 错误识别 | 识别 ChatGPT 代码输出中的错误,包括细微的错误。 |

| 批评的产生 | 生成批评,突出 ChatGPT 答案中的不准确之处。 |

| 人类增强 | 增强人类训练师的技能,从而产生比单纯的人类更全面的批评。 |

| 减少幻觉 | 与 ChatGPT 相比,产生的幻觉(假阳性)和挑剔(无益的批评)更少。 |

| 增强型 RLHF 标记 | 通过提供明确的 AI 辅助来提高 RLHF 标记的效率和准确性。 |

| 测试时间搜索 | 使用额外的测试时间搜索来生成更长、更全面的批评。 |

| 精确度-召回率权衡配置 | 允许配置幻觉率和检测到的错误数量之间的权衡。 |

CriticGPT 的训练采用 RLHF 方法。但与 ChatGPT 不同的是,CriticGPT 看到大量有错误的输入,然后必须批评这些错误。AI 训练员手动将错误添加到 ChatGPT 编写的代码中,然后编写示例反馈,就好像他们发现了自己添加的错误一样。通过比较对修改后的代码的多个批评,同一个人可以轻松识别出批评何时发现了他们添加的错误。实验检查 CriticGPT 是否捕获了插入的错误以及之前的训练员发现的“自然发生的”ChatGPT 错误。63% 的时间里,对于自然发生的错误,讲师更喜欢 CriticGPT 批评而不是 ChatGPT 批评。

CriticGPT 也存在一些局限性。该模型是在简短的 ChatGPT 响应上进行训练的。为了在未来监督更长、更复杂的任务,需要开发方法来帮助训练师理解这些任务。此外,模型仍然会产生幻觉,有时,训练师在看到这些幻觉后会犯下标记错误。在某些情况下,现实世界的错误可能会分散在答案的许多部分。OpenAI 强调需要更好的工具来协调日益复杂的 AI 系统。对 CriticGPT 的研究显示了将 RLHF 应用于 GPT-4 的潜力,以帮助人们为 GPT-4 生成更好的 RLHF 数据。OpenAI 计划进一步扩大这项工作的规模并将其付诸实践。

特色图片来源:OpenAI