OpenAI 终于推出了 GPT-4,这是他们备受期待的新图像和文本理解 AI 模型,他们将其描述为“扩大深度学习努力的最新里程碑”。

OpenAI 今天已通过其 API、候补名单和 ChatGPT Plus(对其流行的人工智能聊天机器人的付费升级)访问 GPT-4。

这是 GPT-4,这是我们迄今为止功能最强大、最一致的模型。 它今天在我们的 API(有候补名单)和 ChatGPT+ 中可用。https://t.co/2ZFC36xqAJ

它仍然有缺陷,仍然有限,并且在第一次使用时看起来仍然比你花更多时间后更令人印象深刻。

——山姆奥特曼 (@sama) 2023 年 3 月 14 日

什么是 OpenAI GPT-4?

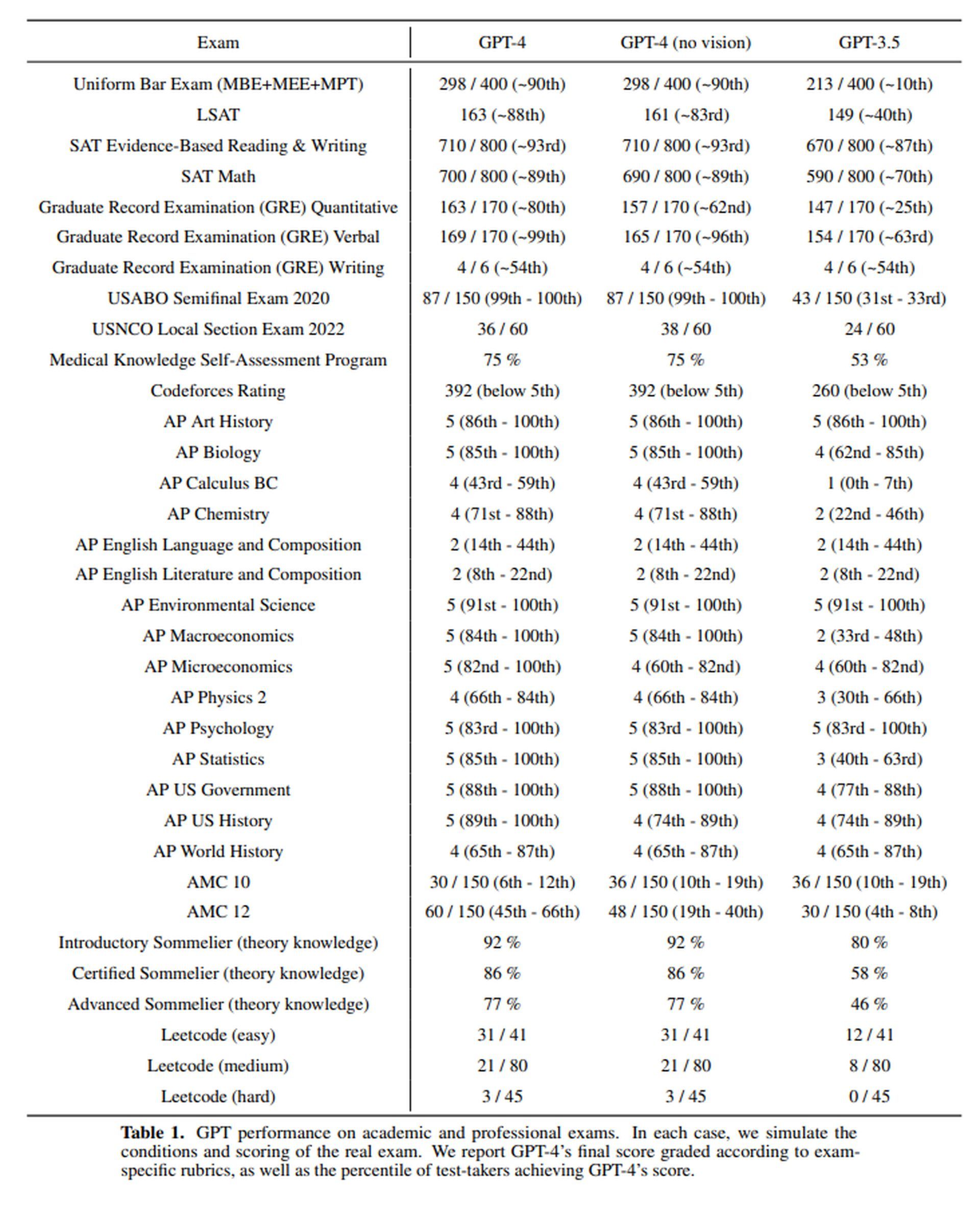

GPT-4 是 OpenAI 最新的 LLM。 OpenAI 声称 GPT-4 在各种专业和学术标准上的表现达到了“人类水平”,并且可以接受图像和文本输入,这是对其仅接受文本的前身 GPT-3.5 的升级。

宣布 GPT-4,一个大型多模式模型,在功能和对齐方面取得了有史以来最好的结果:https://t.co/TwLFssyALF pic.twitter.com/lYWwPjZbSg

— OpenAI (@OpenAI) 2023 年 3 月 14 日

该公司声称,OpenAI 使用对抗性测试程序和 ChatGPT 的经验教训进行了六个月的迭代调整,以在真实性、可操纵性和拒绝超越护栏方面获得“有史以来最好的结果”。

“在随意的谈话中,GPT-3.5 和 GPT-4 之间的区别可能很微妙,”OpenAI 在宣布 GPT-4 的博客文章中写道。 “当任务的复杂性达到足够的阈值时,差异就会出现——GPT-4 比 GPT-3.5 更可靠、更有创意,并且能够处理更细微的指令。”

-OpenAI

根据 OpenAI 对 GPT-4 的介绍,与 GPT-3.5 相比,该系统“响应不允许内容请求的可能性降低 82%,产生事实响应的可能性提高 40%。” 这种改进是六个月安全培训的结果。

GPT-4 与 GPT-3:最大的区别

尽管 GPT-4 是多模式的,但它的通道比最初预期的要少。 根据 OpenAI 的说法,该系统可以接收文本和图像并生成书面结果。

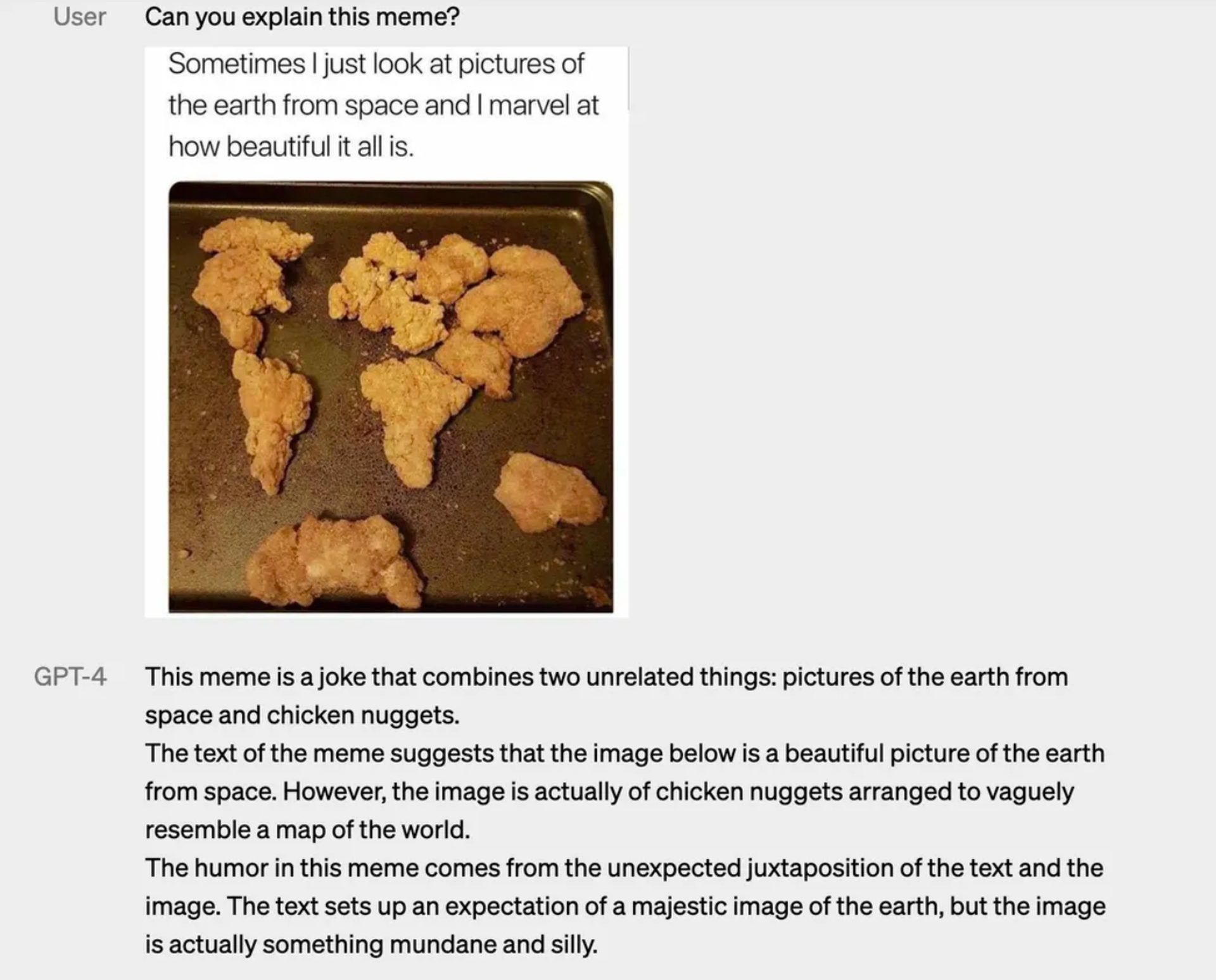

OpenAI 声称它可以理解更细微的数据,因为它可以同时分析文本和图像。 您可能会在下面提供的示例中看到该算法如何描述模因和特殊图像:

同时分析文本和图像并不是唯一的区别。 与 ChatGPT 相比,GPT-4 卓越的推理能力使其处于领先地位。

GPT 能做的事情还没有结束。 总之,这些是 GPT-4 与众不同的地方:

- 更确切

- 提高准确性

- 用令人印象深刻的细节描述图像

- 专业知识

- 它有幽默感

- 它可以解决难题。

- 它可以通过标准化测试。

然而,剧透警告,它仍然是幻觉。

如何使用 GPT-4?

要使用 GPT-4,您必须至少满足以下要求之一:

- API候补名单: 注册 GPT-4 候补名单以获得对 GPT-4 API 的限速访问——它使用与 gpt-3.5-turbo 相同的 ChatCompletions API。 OpenAI 今天将开始邀请一些开发人员,并逐步扩大可用性和速率限制,以平衡容量与需求。

- 优先访问: 开发人员可以获得对 GPT-4 的优先 API 访问权限,以便为合并的 OpenAI Evals 贡献模型评估。

- ChatGPT 加: ChatGPT Plus 订阅者将在 chat.openai.com 上获得 GPT-4 访问权限,并具有动态调整的使用上限。 使用上限将取决于需求和系统性能。 API 访问仍将通过等候名单。

GPT-4 API 定价

- 具有 8K 上下文窗口(约 13 页文本)的 GPT-4 每 1K 提示令牌的成本为 0.03 美元,每 1K 完成令牌的成本为 0.06 美元。

- 具有 32K 上下文窗口(约 52 页文本)的 GPT-4-32k 每 1K 提示令牌的成本为 0.06 美元,每 1K 完成令牌的成本为 0.12 美元。

- GPT-4 的概览页面以及早期客户在该模型之上构建的内容。

- 博客文章,其中包含有关模型功能和限制的详细信息,包括评估结果。

GPT-4 好吗? 让我们测试一下

当我们说让我们测试时,我们不是在开玩笑。 以下是 GPT-4 的测试结果:

GPT-4 比 ChatGPT 表现更好,因为它实现了更高的约。 百分位分数。

Source: 什么是 GPT-4 以及如何使用它:功能、定价等